AI +人类=踢屁股网络安全

人类和AI都没有证明在自己身上维持网络安全的情况下绝对成功,所以为什么没有看到你结合两者时会发生什么?这是从麻省理工学院的新项目的前提,它取得了一些非常令人印象深刻的结果。

MIT计算机科学和人工智能实验室(CSAIL)和机器学习启动Pattern的研究人员开发了一个名为AI2的新平台,可以检测85%的攻击。研究人员表示,它还减少了“假阳性”的数量 - 非威胁被错误地确定为威胁 - 通过五倍于5倍。

该系统在3个月内由数百万用户产生的36亿件数据进行了测试。研究人员提出了一篇论文,本月早些时候在IEEE大数据安全大会上汇总了该项目。

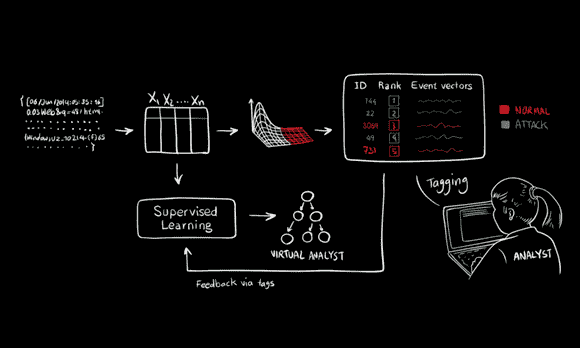

“你可以考虑系统作为虚拟分析师,”CSAIL研究科学家Kalyan Veeramachaneni表示,Si2与Ignacio Arnaldo,图案中的首席数据科学家和前CSAIL Postdoc。“它不断地产生新的模型,可以在几小时内完善它,这意味着它可以显着提高其检测率。”

即使担心人工智能的求职潜力比比皆是,它变得越来越明显,即将AI与人体洞察力结合可以提供比任何一方都可以单独生产的更好的结果。例如,刚刚上周,Squere5发布了一个新的平台,该平台应用人类洞察力和机器学习的组合,以帮助公司了解非结构化数据。

在网络安全世界中,人力驱动的技术通常依赖于生活专家创建的规则,因此错过了任何与规则不符的攻击。另一方面,机器学习方法依赖于异常检测,这往往会触发产生对系统的不信任的误报,并且仍然最终必须由人类调查。

创建合并基于计算机和基于计算机的方法的网络安全系统是不容易的,但部分原因是因为手动标记算法的网络安全数据的挑战。对于许多任务,例如视觉认可,标签只是在亚马逊机械土耳其群岛上征收少数人类志愿者的问题,但没有许多工人具有应用“DDOS”或“exfiltration攻击”这样的标签所需的技能Veeramachaneni说。“你需要安全专家。”

同时,专家往往会按时短暂。认识到该约束,AI2首先使用机器学习来找到最重要的潜在问题;只有那么它才会向分析师展示标签的顶级活动。在其一天的培训之一时,AI2采用无监督机器学习选择200“最异常”的事件,并将其提供给人类专家,麻省理工学院解释说明。然后,那些分析师确认哪些事件是实际攻击,系统将该反馈包含在其模型中为下一组数据。

麻省理工学院说,随着时间的推移,随着时间的推移改善,事件分析师的数量必须急剧下降。

“攻击系统检测到的越野,它接收的分析师反馈就越好,这又提高了未来预测的准确性,”Veeramachaneni说。“人机互动创造了一个美丽的级联效果。”